ChatGPT a devenit o soluție extraordinar de populară pentru activitățile profesionale. Un sondaj Kaspersky a arătat că 11% dintre respondenți au folosit chatbots, iar aproape 30% cred în potențialul lor de a înlocui unele locuri de muncă în viitor. Alte sondaje indică faptul că 50% dintre angajații de birou belgieni și 65% din Marea Britanie se bazează pe ChatGPT. Mai mult, frecvența termenului de căutare „ChatGPT” în Google Trends sugerează o utilizare pronunțată în timpul săptămânii, probabil legată de sarcinile de serviciu.

Cu toate acestea, integrarea tot mai mare a chatbot-urilor la locul de muncă ridică o întrebare crucială: se pot încredința date sensibile ale unei companii unui chatbot? Iată patru riscuri cheie asociate cu utilizarea ChatGPT în scopuri comerciale.

- Deși chatbot-urile bazate pe LLM sunt operate de specialiști în tehnologie, nici ei nu sunt imuni la hacking sau scurgeri accidentale. De exemplu, a avut loc un incident în care utilizatorii ChatGPT au putut să vadă mesaje din istoricul de chat al altor utilizatori.

- Teoretic, chat-urile cu chatbot-uri ar putea fi folosite pentru a antrena viitoare modele. Având în vedere că LLM-urile sunt susceptibile la „memorare neintenționată”, în care își amintesc secvențe unice, cum ar fi numerele de telefon, care nu îmbunătățesc calitatea modelului, dar prezintă riscuri pentru confidențialitate, orice date din materialul de instruire pot fi accesate involuntar sau intenționat de alți utilizatori din model.

- „Malicious client” – Aceasta este o mare îngrijorare în cazul locurilor de muncă în care serviciile oficiale precum ChatGPT sunt blocate. Utilizatorii pot recurge la alternative neoficiale, cum ar fi programe, site-uri web sau roboți de mesagerie și pot descărca programe malware deghizate în client sau aplicație inexistentă.

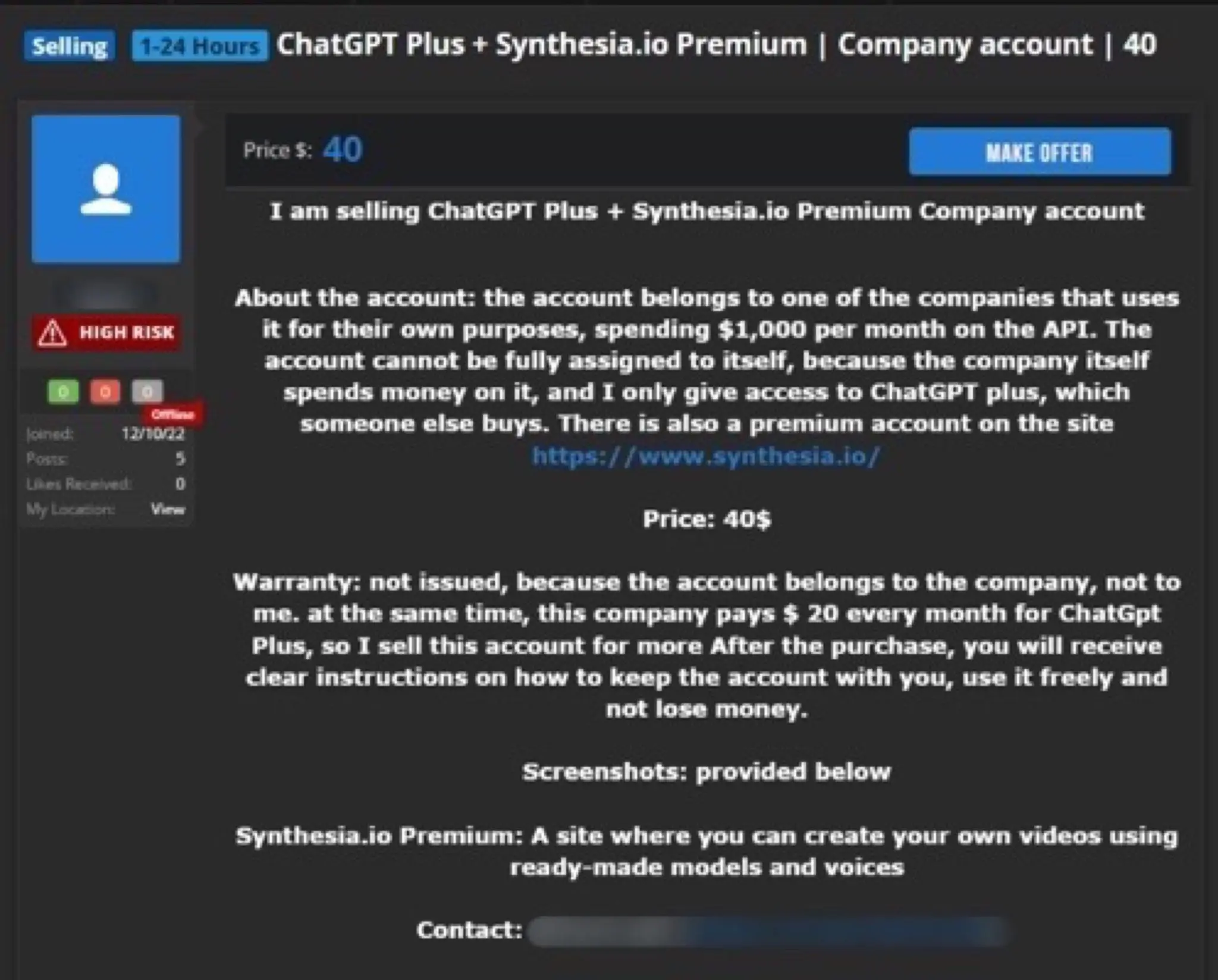

- Atacatorii pot intra în conturile angajaților, accesând datele lor, prin atacuri de tip phishing sau prin completarea acreditărilor. În plus, Kaspersky Digital Footprint Intelligence găsește în mod regulat postări pe forumuri dark web care vând acces la conturile chatbot.

Scurgerile de date rămân, prin urmare, o problemă majoră de confidențialitate atât pentru utilizatori, cât și pentru companii atunci când folosesc chatbots. Dezvoltatorii responsabili descriu modul în care datele sunt utilizate pentru antrenarea modelelor în politicile lor de confidențialitate. Analiza Kaspersky a chatbot-urilor populare, inclusiv ChatGPT, ChatGPT API, Anthropic Claude, Bing Chat, Bing Chat Enterprise, You.com, Google Bard și Genius App de Alloy Studios, arată că în sectorul B2B există standarde de securitate și confidențialitate mai ridicate, având în vedere riscurile mai mari generate de scurgerile de informații corporative. În consecință, termenii și condițiile de utilizare, colectare, stocare și procesare a datelor sunt mai concentrate pe protejarea datelor, în comparație cu sectorul B2C. Soluțiile B2B din acest studiu, de obicei, nu salvează automat istoricul de chat și, în unele cazuri, nu sunt trimise date către serverele companiei, deoarece chatbot-ul operează local în rețeaua clientului.